Hapus Deskripsi Gender pada Foto, Google: AI Bisa Salah!

Cyberthreat.id – Perangkat kecerdasan buatan (artificial intelligence/AI) Google kini tidak lagi bisa mendeteksi atau mengenali foto dengan deskripsi lelaki atau perempuan. Tujuannya, untuk menghindari bias atau penyimpangan dalam menyimpulkan gender atau jenis kelamin.

Dalam pernyataan tertulis kepada Business Insider Belanda, Kamis (20 Februari 2020), Google mengatakan, tidak akan lagi menggunakan "label gender" untuk tag pada foto-foto. Sebagai gantinya, Google hanya menandai foto orang dengan label "non-gender", seperti "orang”.

Alasan Google menghapus label tersebut karena “tidak mungkin untuk menyimpulkan jenis kelamin seseorang hanya dari penampilan mereka,” tulis Google.

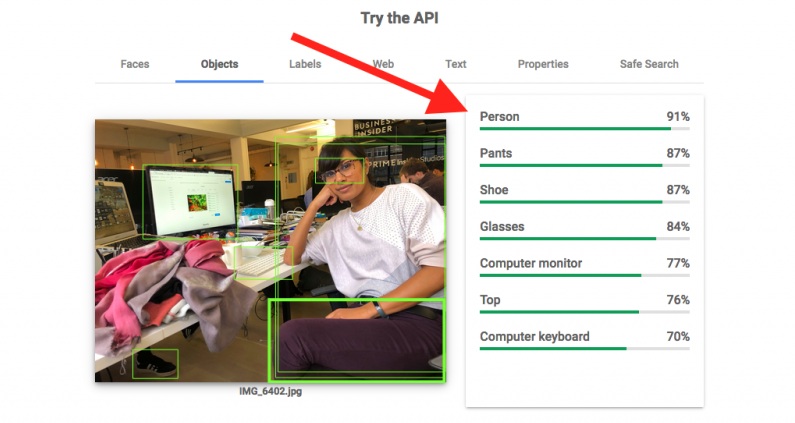

Cloud Vision API adalah layanan dari Google yang disediakan untuk pengembang guna melampirkan label pada foto. Layanan berbasis kecerdasan buatan ini mampu mendeteksi wajah, logo merek, dan konten eksplisit, termasuk dapat mengidentifikasi spesies hewan.

Alasan lain, dalam etika AI Google, menurut perusahaan, foto-foto gender dapat memperburuk bias yang tidak adil. "Kami telah memutuskan untuk menghapus label ini agar selaras dengan Prinsip Kecerdasan Buatan di Google, khususnya ‘Prinsip #2 Hindari membuat atau memperkuat bias yang tidak adil’," tutur Google.

Business Insider selanjutnya melakukan uji coba perintah melalui Cloud Vision API. Hasilnya, Google memang telah menghapus status gender dan menjadi seperti berikut ini:

Hasil deteksi AI Google terhadap foto setelah perusahaan menghapus deskripsi gender. | Foto: Business Insider Nederland/Shona Ghosh

Bias dalam kecerdasan buatan (AI) adalah topik yang banyak dibahas para peneliti teknologi. Salah satu contohnya adalah algoritma pengenal wajah yang salah mengidentifikasi orang kulit berwarna lebih sering daripada orang kulit putih.

Peneliti dan ahli kebijakan teknologi AI di Mozilla, Frederike Kaltheuner, mengatakan, pembaruan Google tersebut dinilai sangat positif.

Menurut dia, mengklasifikasikan seseorang secara otomatis, apakah jenis kelamin atau orientasi seksual—lalu diputuskan untuk masuk pada kategori mana—cenderung hal itu dilakukan dengan banyak asumsi.

“Mengklasifikasikan orang sebagai lelaki atau perempuan adalah mengasumsikan bahwa gender adalah biner (hanya terdiri dua jenis saja, red). Siapa pun yang tidak cocok dengan itu akan secara otomatis salah klasifikasi dan salah tempat,” ia menambahkan.

“Jadi, ini lebih dari sekadar bias. Karenanya, jenis kelamin seseorang tidak dapat disimpulkan oleh penampilan. Sistem AI apa pun yang mencoba melakukan itu pasti akan membuat orang keliru,” ujar Kaltheuner.

Google juga menyatakan, akan berupaya menghindari dampak yang tidak adil pada seseorang, terutama yang terkait dengan karakteristik sensitif seperti ras, etnis, jenis kelamin, kebangsaan, pendapatan, orientasi seksual, kemampuan, dan keyakinan politik atau agama.[]

Redaktur: Andi Nugroho

Google | Foto: searchengineland.com

Google | Foto: searchengineland.com